생성형 인공지능 챗봇 ‘챗GPT’ 등장 이후 대책 마련에 나서는 대학이 늘고 있다. 학생들이 챗GPT를 활용해 과제 대필 등 부정행위 가능성이 있기 때문이다.

국민대는 지난달 2일 국내 대학 최초로 인공지능 활동 윤리강령을 선포했다. 윤리강령에는 ‘인공지능의 사용 여부는 교수와 학생이 상호합의한다’, ‘인공지능 활용 여부를 과제 제출 시 명확히 밝힌다’ 등의 내용이 담겨있다.

부산대는 지난달 30일 ‘AI 활용 가이드라인’을 발표했다. 이 가이드라인에는 생성형AI에 대한 올바른 활용 원칙을 제시하고, 교수자와 학습자의 지성과 창의성 계발, 상호존중과 다양성, 강의현장의 안전과 교육적 윤리 등에 대한 내용을 담았다. 또한, 표절, 부정행위 등을 방지하기 위해 ‘부산대 교수·학습 AI 활용 가이드라인’도 마련했다.

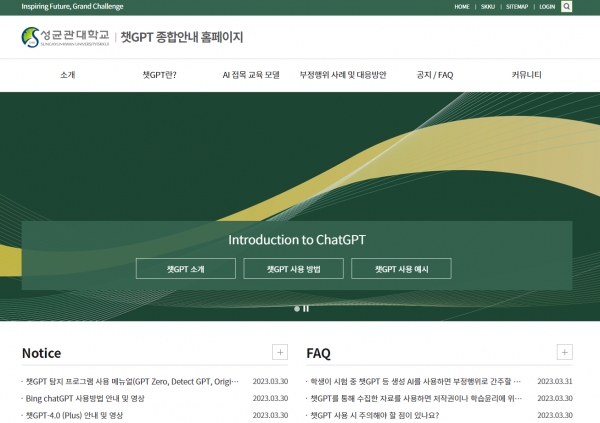

성균관대는 지난 10일 교수‧강사 등이 활용할 수 있는 챗GPT 부정행위 대응 플랫폼을 개설했다. 이 플랫폼에는 AI를 활용한 부정행위를 방지하고 탐색할 수 있는 교강사용 행동요령이 담겼다. 공교육 관계자를 위해 AI 접목 교육 모델을 소개하고, 챗GPT를 활용한 부정행위 대처 방법 등을 집중적으로 강조했다. GPT Zero, Detect GPT, Originality.AI와 같은 탐지 프로그램 사용 방법 등이 홈페이지 내에 안내돼 있다.

고려대도 지난 16일 챗GPT 등 생성형 AI 활용 가이드라인을 마련했다. 고려대는 챗GPT를 이용한 표절 방지를 위해 교수는 수업 초반에 학문적 진실성 위반 행위 방지 교육과 인공지능의 윤리적 사용에 대해 교육해야 한다는 점을 기본 원칙으로 삼았다.

세종대도 지난 17일 생성형 AI 활용 가이드라인을 발표했다. 세종대는 학생들에게 생성형 AI의 결과물을 직접 검토하고 선별적으로 사용하도록 주지하고, 검토 없이 제출된 결과물로 인해 발생된 문제의 책임은 학생에게 있음을 안내하도록 교수들에게 권고했다.

대학가의 챗GPT 등 생성형 AI에 대한 대책 마련은 이어질 전망이다.

신다인 기자 shin@kyosu.net

번역 제공

번역 제공